-

Postów

3 098 -

Dołączył

-

Ostatnia wizyta

Treść opublikowana przez maxmaster027

-

Widać, ze rozumiesz jak działa afterburner . No i co z tego co za problem sobie ustawic i sprawdzic...

-

Najlepszy run Average clock frequency 3,182 MHz vs ten test stabilnosci Average clock frequency 3,122 MHz Wiec generalnie zegar miales 60mhz mniej. To u góry to nie patrz na to. Akurat jesteś na takiej karcie, ze mozesz zostawic i tak bedzieszm mial szybciej niz 99% reszty ludzi. Natomiast robia UV po to żeby nie grzało tak i zawsze to mniej pradu ciagnie

-

No do smarkacza. A do gier to i -50Mhz trzeba zejsc z OC ktore działało na benchmarku a czasami i wiecej jezeli mowimy o pelnej stabilnosci. Zalezy jakie GPU sie komu trafiło.

-

NO sciagasz plik dat do msi afterburner i dajesz +3000Mhz

-

4Ghz to pewnie lepsze sztuki na Rubinie beda robic po OC. Realnie pod benchmark tak na jeden run, 3.3GHz jak ustawi pewnie 3.2Ghz w stresie powinno przejsc.

-

Z górki i z wiatrem 3.3Ghz 60k~

-

AMD ZEN 5 (SERIA RYZEN 9xxx / SOCKET AM5) - wątek zbiorczy

maxmaster027 odpowiedział(a) na Ogider temat w AMD

W FPS żadne, co najwyzej shadery mogą sie kompilowac troche szybciej. Lub w specyicznych grach gdzie jest mocne doczytywanie terenu z pamieci ram 1% low moze byc wyzszy. -

NA tym biosie nie działaja wentylatory prawidlowo 100% =20%

-

385mm ... toż to pas startowy

-

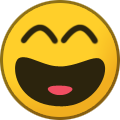

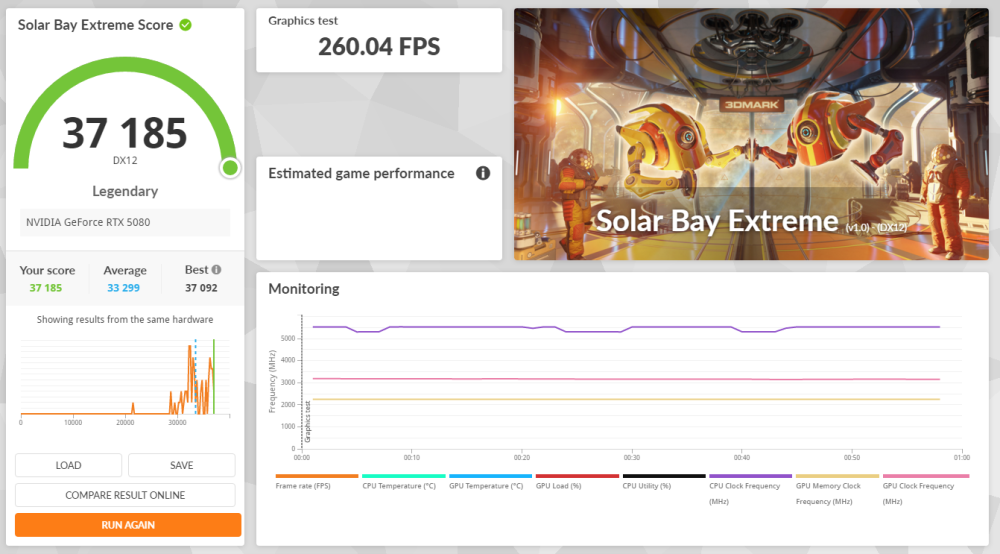

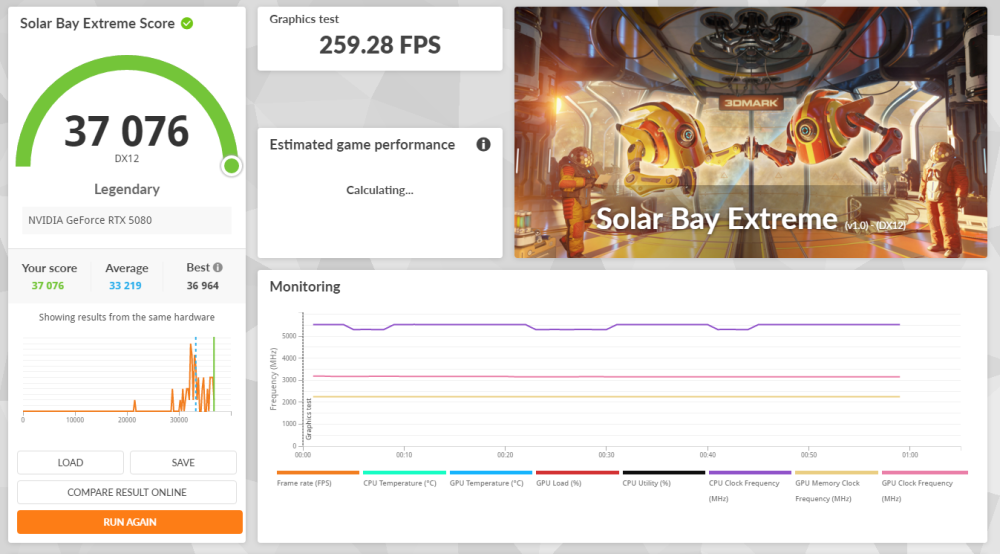

Musiałem jeszcze raz puscic bo nie sprawdzilem 73C na peaku na samym koncu https://www.3dmark.com/3dm/140281938 Ciagnie to non stop 415W nawet 420 potrafi wejsc

-

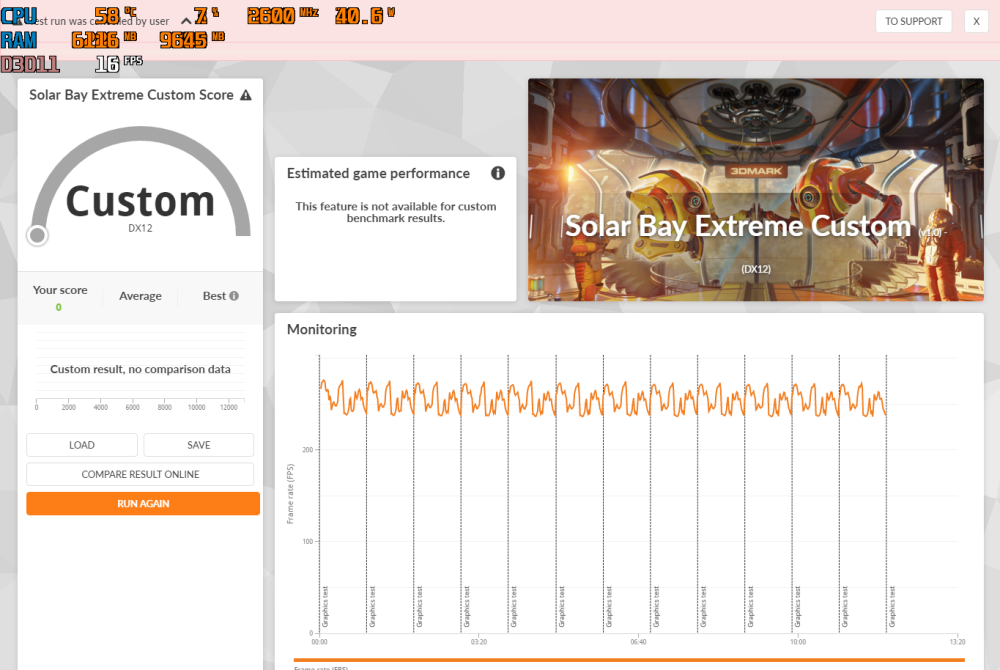

https://www.3dmark.com/3dm/140276075 No to niezły wynik

-

opyla sie gra jest dobra

-

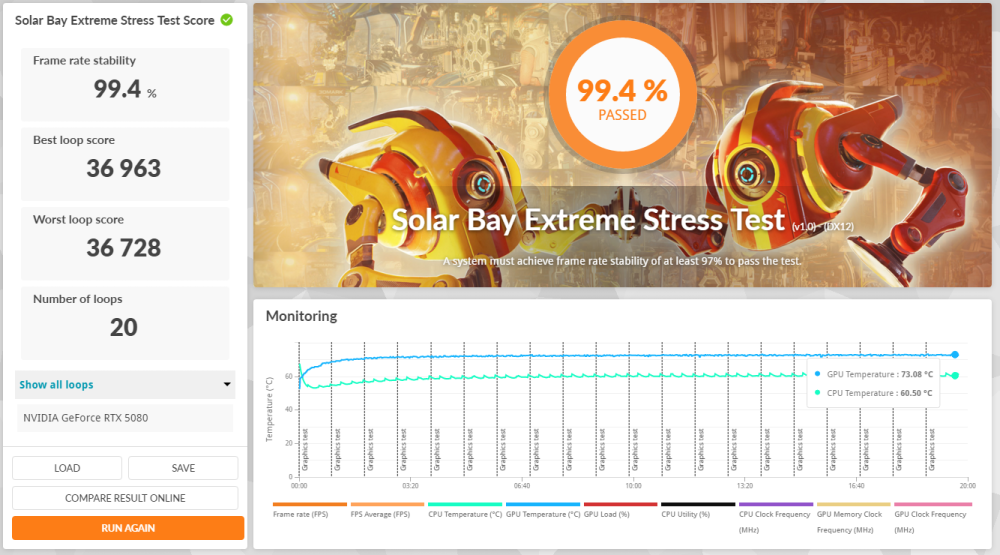

Pusciłem na dłuzej, ale to niczego nie dowodzi, ktos tutaj pisał, ze benchmarkami nie sprawdza sie stabilnosci

-

Chcesz to Ci podrzuce bios i ustawienia, wkleisz sobie, lub znajdziesz sobie wlasne dla swojej karty Mówie Ci ze to nie jest max pusciłem jeszcze wyżej. A to było jeszcze z Gsyncem wlaczonym, nie wiem czy to ma znaczenie ale cos tam FPS moze zabrac. Tylko

-

https://www.3dmark.com/3dm/140249793 Nie chce mi sie przy tym dłubac, ale da sie osiągnać sporo wyzszy wynik jezeli do tego pijesz

-

-

masz moje moze wrzucic swoje vs porównanie No to ciesz sie ze masz taka wydajnosc

-

-

1.On ma 1.1V max napiece 2.Ja mam 1V max napiecie 3. Skończ to biadolenie

-

Podkręcanie pamięci DDR5 (Wszystkie platformy)

maxmaster027 odpowiedział(a) na KamileN temat w Pamięci RAM

8400 na cl34, to raczej musi byc szybkie, @ju-rekA to chyba od proca zalezy to czy uciagnie 1-2-0 itp. Bo wczenisej mi 7800x3d działał 6400 1-2-1, A 6200 1-2-0 a teraz ten nawet 6200 musi miec 1-3-1, i 8000 obowiazkowo 2-3-1. W kazdym badz razie 8400 i 2200 wyglada bardzo ładnie, jeszzcze napiecie 1.56 mógłbys jakies porównanie w grach zrobic do 6400/2133 przez wielu uważane za absolutne apogeum na platformie AMD, ciekawe jak wyglada 6400/2133 vs 8400/2200 -

To i tak sporo. Ale wierze, że gra ma potencjał i zapewne też wyjda updaty. Pytanie co oni mogą zrobić, żeby tą gre chociaż trochę podciągnać do poziomiu tej gry

-

Myślę, że procesor 7800x3d/9800x3d +32GB ram + jakis 4080S/4090/5070Ti/5080/5090 starczy jeszcze na bardzo długo.

-

Zadziałał u mnie 415W bios od Zotaca, poprawiłem wyniki przy okazji, tego mniej wiecej mozna sie spodziewac po OC na nowych 5080 24GB. https://www.3dmark.com/3dm/140132666 Nomad https://www.3dmark.com/3dm/140132966TimeSpy https://www.3dmark.com/3dm/140135080 PortRoyal https://www.3dmark.com/sw/2616393 Speedway Na 640W to zupełnie inna liga.

-

Napisałes że 9800x3d to zajebisty procek ale jest nie do gier. " Bynajmniej – wyraża zdecydowane zaprzeczenie, często w połączeniu z przeczeniem („nie”) Używamy go, by podkreślić, że coś absolutnie nie ma miejsca. Przykłady: „To bynajmniej nie jest moja wina.” „Nie jestem zmęczony, bynajmniej – czuję się świetnie!” „Nie był zły, bynajmniej, był bardzo uprzejmy.” Można go zastąpić słowami: „wcale nie”, „absolutnie nie”, „ani trochę”. Bynajmniej uzywasz np. z nie, prawidlowo0 "9800X3D to zajebisty procek, przynajmniej do gier — bo do tego go używam." Nie żebym sie czepiał, ale mi tez tak kiedys ktos uwage zwrocił ;P

-

Tutaj nie chodzi o to, zobacz ze zrobił porównanie na którym 9800x3d ma trudniejsze ustawienia. Tego nie wychwycisz z video chyba ze wytniesz i porownasz obok siebie. No nie wiem sam juz. Dziwne, że te cienie na AMD sa zdecydowanie lepsze. Byc może po prostu przez przypadek przestawiły mu sie ustawienia, albo cos. Nie mowie ze zrobił to umyslnie, no ale cienie na AMD sa zdecydowanie lepsze i bardziej nasycone i duzo dalsze, co ma znaczenie w przypadku krzakow drzew itp dla procesora